Чат-боты, такие как GoogleLaMDA от OpenAI или ChatGPT от OpenAI не разумны и не настолько умны. Тем не менее ученые считают, что они могут использовать эти большие языковые модели для имитации человеческого поведения, вдохновленного одной из самых популярных в мире ранних компьютерных игр и некоторым кодом ИИ.

Последняя работа в этом направлении была предпринята шестью учеными-компьютерщиками — пятью из Стэнфордского университета и одним из Google Исследования – Парк Джун Сунг, Джозеф О’Брайен, Кэрри Кай, Мередит Рингел Моррис, Перси Лян и Майкл Бернстайн. Проект очень похож на дань уважения классической игре Maxis The Sims, которая дебютировала в 2000 году и живет в EA в различных продолжениях.

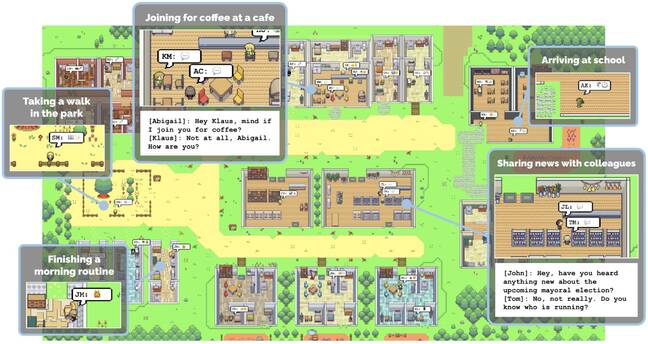

Скриншот из парка и другиедокумент об их программном обеспечении на базе ChatGPT, иллюстрирующий, чем занимается каждый агент в симуляции, и их разговоры.

Как описано в их недавнем препринте «Генеративные агенты: интерактивные симулякры человеческого поведения», исследователи разработали программную архитектуру, которая «хранит, синтезирует и применяет соответствующие воспоминания для создания правдоподобного поведения с использованием большой языковой модели».

Или, говоря более кратко, они добавили память, отражение (вывод из воспоминаний) и код планирования в ChatGPT для создания генеративных агентов — смоделированных личностей, которые взаимодействуют и преследуют свои собственные цели, используя текстовое общение на естественном языке.

«В этой работе мы демонстрируем генеративных агентов, заполняя песочницу, напоминающую The Sims, двадцатью пятью агентами», — объясняют исследователи. «Пользователи могут наблюдать и вмешиваться, когда агенты планируют свои дни, делятся новостями, налаживают отношения и координируют групповые действия».

Для этого посетите демонстрационный мир, работающий на экземпляре Heroku, созданном с помощью среды веб-игр Phaser. Посетители могут взаимодействовать с предварительно вычисленным воспроизведением сеанса, пока эти программные агенты живут своей жизнью.

Демонстрация, посвященная агенту по имени Изабель и ее попытке спланировать вечеринку в честь Дня святого Валентина, позволяет посетителям изучить данные о состоянии смоделированных личностей. То есть вы можете нажать на них и увидеть их текстовые воспоминания и другую информацию о них.

Например, генеративный агент Раджив Пател имел следующую память на 2023-02-13 20:04:40:

Цель этого исследования — выйти за рамки фундаментальной работы, такой как движок Eliza 1960-х годов, и усилий по обучению с подкреплением, таких как AlphaStar для Starcraft и OpenAI Five для Dota 2, которые сосредоточены на враждебных средах с четкими целями победы и архитектурой программного обеспечения, которая поддается программным агентам.

«За последние четыре десятилетия появился разнообразный набор подходов к созданию правдоподобных агентов. Однако при реализации эти подходы часто упрощали среду или параметры поведения агентов, чтобы сделать усилия более управляемыми», — объясняют исследователи. «Однако их успех в основном был достигнут в состязательных играх с легко определяемыми наградами, для которых алгоритм обучения может оптимизировать».

Исследователи отмечают, что большие языковые модели, такие как ChatGPT, кодируют широкий спектр человеческого поведения. Таким образом, при подсказке с достаточно узким контекстом эти модели могут генерировать правдоподобное поведение человека, что может оказаться полезным для автоматизированного взаимодействия, которое не ограничивается определенным набором заранее запрограммированных вопросов и ответов.

Но моделям нужны дополнительные леса, чтобы создать правдоподобных симулированных личностей. Вот где вступают в игру память, размышления и планирование.

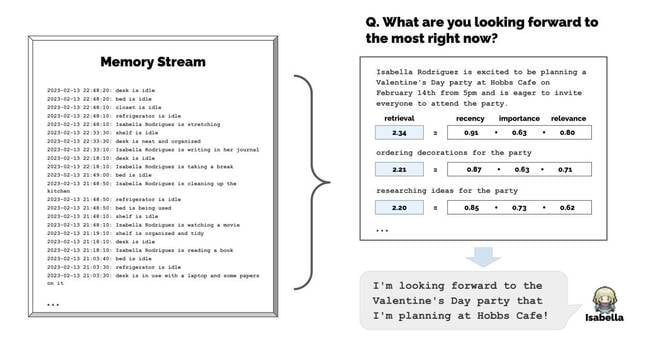

«Агенты воспринимают свое окружение, и все восприятия сохраняются в комплексной записи опыта агента, называемой потоком памяти», — заявляют исследователи в своей статье.

«Основываясь на их восприятии, архитектура извлекает соответствующие воспоминания, а затем использует эти извлеченные действия для определения действия. Эти извлеченные воспоминания также используются для формирования долгосрочных планов и для создания отражений более высокого уровня, которые вводятся в память. поток для будущего использования».

Иллюстрация потока памяти, разработанного учеными, взята из их статьи.

Поток памяти — это просто список с метками времени наблюдений, релевантных или нет, о текущей ситуации агента. Например:

Рефлексия — это тип памяти, периодически генерируемый, когда оценки важности превышают определенный порог. Они создаются путем запроса большой языковой модели о недавнем опыте агента, чтобы определить, что следует учитывать, а затем ответы на запросы используются для дальнейшего изучения модели, задавая ей такие вопросы, как Какой темой увлечен Клаус Мюллер? и Какие отношения между Клаусом Мюллером и Марией Лопес?

Затем модель генерирует ответ, например Клаус Мюллер посвятил себя исследованиям в области джентрификации. и это используется для формирования будущего поведения и модуля планирования, который создает ежедневный план для агентов, который можно изменить посредством взаимодействия с другими персонажами, преследующими свои собственные цели.

Это не закончится хорошо

Более того, агенты успешно общались друг с другом, что привело к тому, что исследователи называют эмерджентным поведением.

«Во время двухдневной симуляции число агентов, знавших о кандидатуре Сэма на пост мэра, увеличилось с одного (4 процента) до восьми (32 процента), а количество агентов, знавших о партии Изабеллы, увеличилось с одного (4 процента) до двенадцати (48 процентов). ), совершенно без вмешательства пользователя», — говорится в документе. «Ни один из тех, кто утверждал, что знает об этой информации, не галлюцинировал ее».

Были какие-то галлюцинации. Агент Изабелла знала об объявлении агента Сэма о баллотировании на пост мэра, хотя у них никогда не было этого разговора. А агентство Юрико «описало своего соседа, Адама Смита, как соседа-экономиста, написавшего книгу «Богатство народов», автором которой был одноименный экономист 18-го века».

Однако в смоделированном городе Смоллвиль дела в основном шли хорошо. Пришли пятеро из двенадцати гостей, приглашенных на вечеринку в кафе Hobbs. Трое не пришли из-за конфликтов в расписании. А остальные четверо проявили интерес, но не явились. Тогда это было близко к реальной жизни.

Исследователи говорят, что их архитектура генеративного поведения создала наиболее правдоподобное поведение, по оценке людей-оценщиков, по сравнению с версиями архитектуры, которые отключили рефлексию, планирование и память.

Ограничения

В то же время они признали, что их подход не лишен некоторых шероховатостей.

Со временем поведение стало более непредсказуемым, поскольку объем памяти увеличился до такой степени, что поиск наиболее релевантных данных стал проблематичным. Было также неустойчивое поведение, когда естественный язык, используемый для воспоминаний и взаимодействий, не содержал важной социальной информации.

«Например, в общежитии колледжа есть ванная, которую может занять только один человек, несмотря на ее название, но некоторые агенты предположили, что ванная комната предназначена для более чем одного человека, потому что ванные комнаты общежития, как правило, поддерживают более одного человека одновременно и выбирают вход. это когда внутри находится еще один человек», — пояснили авторы.

Точно так же генеративные агенты не всегда понимали, что не могут войти в магазины после их закрытия в 17:00 по местному времени — явно ошибка. Такие проблемы, по словам ученых, можно решить с помощью более подробных описаний, таких как описание ванной комнаты в общежитии как «ванная комната для одного человека» вместо «ванная комната в общежитии» и добавление нормативных часов работы к описаниям магазинов.

Исследователи также отмечают, что их подход был дорогостоящим — токены ChatGPT стоили тысячи долларов за двухдневную симуляцию — и что необходимо проделать дополнительную работу для устранения предвзятости, неадекватных данных модели и безопасности.

Они отмечают, что генеративные агенты «могут быть уязвимы для быстрого взлома, взлома памяти — когда тщательно продуманный разговор может убедить агента в существовании прошлого события, которого никогда не было — и галлюцинаций, среди прочего».

Ну, по крайней мере, они не гоняют несколько тонн стали на большой скорости по дорогам общего пользования. ®